Sistema ottico Stereoscopico per acquisizione 3-D

Il sistema di rilevazione digitale 3-D usato per lo svolgimento di questa tesi è una tecnica “attiva” di acquisizione stereoscopica basata sulla triangolazione ottica, fa uso pertanto di sorgenti luminose artificiali che proiettano sequenze di immagini strutturate. L’attrezzatura è costituita complessivamente da due telecamere CCD, un proiettore multimediale DLP ed un personal computer al quale le periferiche ottiche sono collegate tramite una scheda video dual-head ed una scheda di acquisizione dati IEEE 1394 ( fig. 3.1 ).

Tale sistema ha un costo molto contenuto, essendo assemblato con componenti facilmente trovabili sul mercato e garantisce flessibilità e versatilità nei vari settori di applicazione ed un buon risultato in termini di accuratezza di misura nella rilevazione di oggetti 3-D .

3.1

Configurazione Hardware

Il display DLP utilizzato è un NEC LT170 ( di risoluzione 1024 x 768 pixels ) caratterizzato dalla presenza di microscopici specchi (di forma quadrata e lato di 16 µm) controllati elettrostaticamente ed in modo indipendente l’uno dall’altro, in tal modo la proiezione dei vari patterns di luce codificata avviene tramite la commutazione meccanica ed ottica di ogni singolo microspecchio.

E’ dotato di ghiera di regolazione posta vicino alla messa a fuoco ( fig. 3.2 ), che permette di variare la focale dell’ottica interna da 38 a 43 mm, ottenendo un ingrandimento dell’immagine proiettata. Ha una luminosità di 1100 ANSI-Lumen che lo rende abbastanza flessibile alle varie condizioni di esercizio (fig. 3.3).

La versatilità del proiettore, il quale non richiede interventi alcuni e non necessita di calibrazione, consente così di adattare e programmare la sorgente luminosa secondo le differenti necessità, variando in modo opportuno ad esempio l’orientazione, la densità, il colore e le frequenze di emissione della luce strutturata.

Figura 3.3 Specifica tecnica del Proiettore Nec DLP LT170.

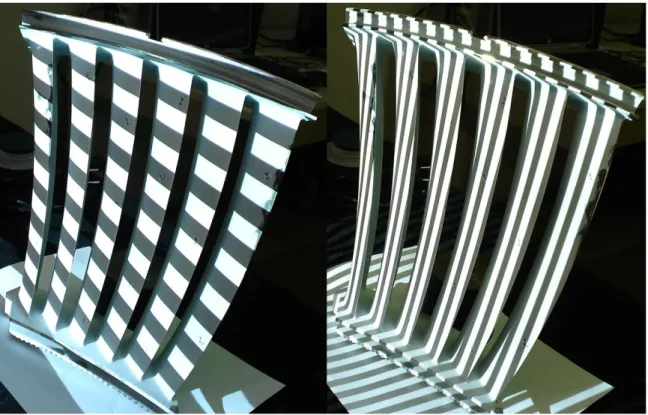

La Gray-Code usata per la generazione in sequenza temporale di patterns luminosi consiste nella proiezione e contemporanea acquisizione con la coppia di telecamere di una serie di linee definite come linee di passaggio da pixel scuri a pixel chiari prodotte da immagini a frange bianche e nere generate con il proiettore, sia orizzontalmente che verticalmente ( fig. 3.4 ).

Figura 3.4 Proiezione della sequenza di immagini a frange bianche e nere.

Ogni immagine proiettata, caratterizzata da un periodo di frange progressivamente dimezzato, è identificata da un codice binario e consente di generare e correlare univocamente linee ( fig. 3.5 ) sull’oggetto reale investito dal volume di luce codificata. Queste linee di passaggio vengono acquisite dalle telecamere CCD dove ciascun pixel è caratterizzato da un’intensità luminosa chiara ( bianco ) o scura ( nero ) in base alla sua posizione. Ad ogni pixel è assegnato un codice binario ( 0,1 ) a n bit, dove n è il numero di immagini proiettate ( o acquisite ) ed il valore 0 o 1 è associato all’intensità luminosa ( 0=nero, 1=bianco ).

1 2 − = n

l

Per risolvere il problema della corrispondenza tra i punti coniugati del sistema di visione stereo vengono proiettate frange verticali ed orizzontali ( immagini ) che consentono di assegnare un doppio codice ai punti d’intersezione delle linee di passaggio verticali ed orizzontali. In tal modo si garantisce una corrispondenza automatica ed univoca tra i punti d’intersezione ( punti coniugati ) localizzati nelle immagini delle telecamere CCD.

h v n n ×

La risoluzione ottenibile è uguale a

l

v×

l

h punti, dove e rappresentano rispettivamente il numero di linee proiettate verticali ed orizzontali.v l

l

hIl proiettore DLP utilizzato consente di generare 784.641 punti con =1023 e =767, sfruttando la massima risoluzione di cui dispone .

v

l

l

hFigura 3.5 Schema del processo di correlazione di linee e punti coniugati.

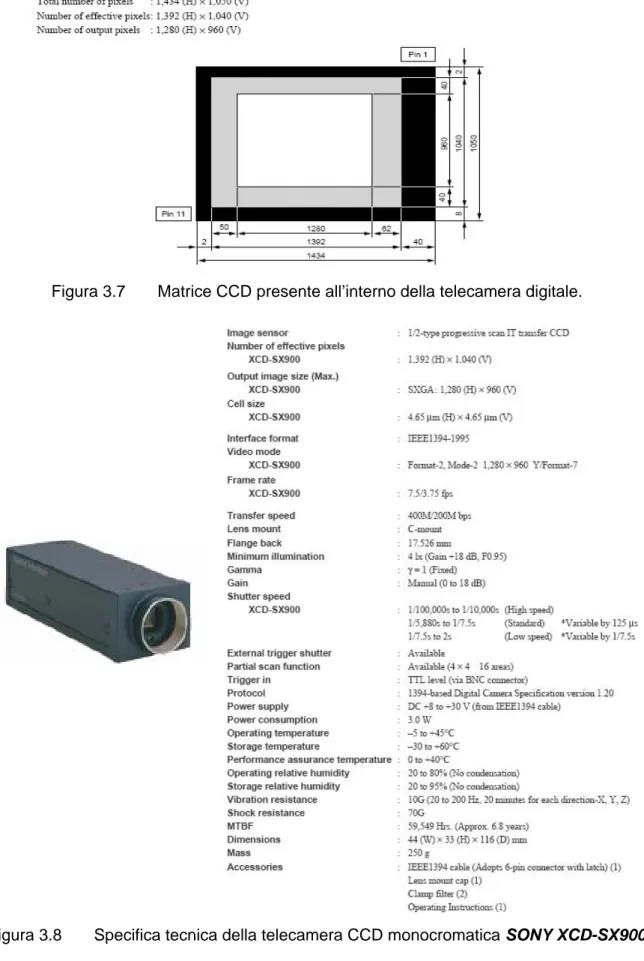

L’acquisizione dei dati durante la proiezione delle immagini a frange bianche e nere è stata realizzata mediante due telecamere CCD ( fig. 3.7 ) monocromatiche ad alta risoluzione ( 1280 x 960 pixels) XCD-SX900 Sony ( fig. 3.8 ), su ognuna delle quali era montato un obbiettivo Cosmicar/Pentax H1214-M(KP) con focale ottica di 12mm.

Gli obbiettivi ( fig. 3.6 ) sono provvisti di viti per il bloccaggio della regolazione della messa a fuoco e dell’apertura del diaframma. Inoltre le telecamere CCD sono estremamente compatte, leggere ed insensibili alle vibrazioni, pertanto adatte all’uso nei vari settori industriali.

Figura 3.7 Matrice CCD presente all’interno della telecamera digitale.

3.2

Schematizzazione dello Scanner 3-D

La totalità delle applicazioni basate su sistemi visivi per la rilevazione delle coordinate 3-D di un oggetto reale necessitano di una fase di set-up relativa alla posizione, al settaggio dell’ottica ed all’orientazione del sistema stesso.

È pertanto fondamentale la calibrazione del sistema visivo e di tutti i suoi parametri. In letteratura il criterio più utilizzato per la schematizzazione geometrica della proiezione prospettica di un punto oggetto da un sistema di coordinate globali tridimensionali ad un sistema bidimensionale solidale alla matrice di sensori della telecamera CCD è il Perfect Pin-Hole Model ( fig. 3.9 ) [12].

Figura 3.9 Illustrazione geometrica del Perfect PinHole Model.

Il modello rappresentate la telecamera è costituito da due piani posti a distanza

( distanza focale ), il primo dei quali presenta nel punto un piccolissimo foro attraverso il quale possono passare i raggi di luce riflessi dall’oggetto reale posto nel punto P, formando sul piano situato posteriormente ( Piano Immagine o Piano Di Retina ) l’immagine ribaltata .

f

O

mf

P

Geometricamente è individuabile un piano detto Piano di Retina, con sistema di coordinate bidimensionale

(

X ,

fY

f)

, sul quale si forma l’immagine del puntoproiettata prospetticamente. Il punto , centro ottico o fuoco dove è situata la lente della telecamera, posto alla distanza focale dal piano di retina, è utilizzato per

formare l’immagine, di coordinate , del punto tridimensionale .

P

mO

f

)

(

x ,

uy

u T w w wy

z

x

P

=

[

]

Questa viene ottenuta come intersezione del piano di retina con la retta

PO

m .L’asse ottico interseca perpendicolarmente il piano di retina nel punto , detto

punto principale.

f

O

La trasformazione rigida di coordinate tra il sistema di riferimento assoluto e quello solidale alla telecamera può essere formulata in questo modo

T

z

y

x

R

z

y

x

w w w T m m m+

⎥

⎥

⎥

⎦

⎤

⎢

⎢

⎢

⎣

⎡

=

⎥

⎥

⎥

⎦

⎤

⎢

⎢

⎢

⎣

⎡

, ( 3.1) doveR

[

n

xn

yn

z]

)

)

)

=

e sono rispettivamente la matrice rotazione ed il vettore traslazione che definiscono la trasformazione di coordinate.]

[

T z y xT

T

T

T

=

La relazione che determina le coordinate dell’immagine ideale ( non distorta ) del punto oggetto tridimensionale sul piano di retina è del tipo

z T z x T x m m u T P n T P n f z x f x + + = = )) z T z y T y m m u T P n T P n f z y f y + + = = )) .

⎩

⎨

⎧

( 3.2 )Un aspetto che necessariamente deve essere preso in considerazione, qualsiasi sia il tipo di ottica utilizzata, riguarda la presenza di varie tipologie di distorsioni proprie delle lenti [11].

In genere esistono tre forme di distorsione delle lenti: distorsione radiale, distorsione tangenziale e distorsione prismatica.

Pertanto è necessario introdurre dei parametri correttivi e dei fattori di scala che tengano conto di questo aspetto nel modello ideale ( Pin-Hole Model ) della telecamera.

Le coordinate dell’immagine non distorta possono essere espresse attraverso le seguenti espressioni, dove

(

x

d,

y

d)

rappresentano le coordinate dell’immagine distorta :

x

u(

k

r

)

x

d 2 11

+

=

, ( 3.3 )⎩

y

u=

(

1

+

k

1r

2)

y

d⎨

⎧

dover

=

x

d2+

y

d2 .Pertanto le coordinate immagine del punto oggetto , relative all’acquisizione del punto reale diventano

f

P

T w w wy

z

x

P

=

[

]

d x x x f C S d x x = + −1 ( 3.4 ) yf Cy dy yd 1 − + =⎩

⎨

⎧

dove

(

d

x,

d

y)

rappresentano le dimensioni del pixel della telecamera CCD,(

C ,

xC

y)

costituiscono le coordinate del centro ottico e è un fattore di scala che tiene conto di eventuali errori o imprecisioni di temporizzazione tra l’hardware di acquisizione ( personal computer ) e l’hardware di rilevazione delle telecamere. è generalmentedefinito come f

O

S

x xS

P SN

N

d

k

a

×

1×

×

, dove rappresenta la distanza tra i due centri immaginedelle camere CCD, ed rappresentano rispettivamente il numero di sensori nella direzione orizzontale ( verticale ) della camera CCD ed il numero di pixels sulla linea orizzontale ( verticale ) di scansione dell’immagine.

d

S

N

N

PI parametri del modello Pin-Hole della camera CCD possono essere raggruppati in parametri estrinseci, i quali individuano la posizione tridimensionale e l’orientazione

della telecamera e parametri intrinseci, che regolano le caratteristiche ottiche della telecamera.

Il modello di camera CCD utilizzato in questa tesi include nei parametri intrinseci le coordinate del Centro Ottico

O

f =(

C ,

xC

y)

, cinque coefficienti di distorsione ( tre per la distorsione radiale e due per la distorsione tangenziale ), la distanza focale espressa in pixelsdist

k

(

x,

y)

f

=

f

f

ed un parametro detto Skew coefficient che definisce l’angolo tra l’assex

e l’assey

del pixel.Nei parametri estrinseci vengono incluse la matrice rotazione

R

, funzione degli angoli caratteristici di Eulero(

θ

,

ϕ

,

ψ

)

ed il vettore traslazioneT

.R T (3.5 ) ⎥ ⎥ ⎥ ⎦ ⎤ ⎢ ⎢ ⎢ ⎣ ⎡ + − + + + − − = ϕ θ ϕ θ ψ ϕ ψ ϕ θ ψ ϕ ψ ϕ θ ϕ θ ψ ϕ ψ ϕ θ ψ ϕ ψ θ θ ψ θ ψ cos cos cos sin sin sin cos cos sin cos sin sin sin cos sin sin sin cos cos cos sin cos cos sin sin cos sin cos cos ⎢ ⎢ ⎢ ⎣ ⎡ ⎥ ⎥ ⎥ ⎦ ⎤ = z y x T T T

Le dimensioni

(

dx,dy) dei pixel della camera CCD sono generalmente note e fornite dal costruttore.In conclusione il processo di calibrazione deve determinare i sei parametri estrinseci e gli undici parametri intrinseci, affinché venga risolta la corrispondenza tra il punto oggetto reale

P

ed il punto immagineP

f acquisito dalla singola telecamera.3.3

Struttura del processo di Reverse Engineering in

ambito Stereovisivo

Il processo di digitalizzazione 3-D su base stereo visiva prevede alcuni step di fondamentale importanza per l’accuratezza della rilevazione dei dati ( acquisizione delle nuvole di punti ) e le successive fasi di reverse engineering.

i. CALIBRAZIONE DEL SISTEMA DI ACQUISIZIONE

ii. ACQUISIZIONE E RICOSTRUZIONE 3-D DEI DATI RILEVATI

( Elaborazione digitale delle nuvole di punti ) iii. REGISTRAZIONE DELLE NUVOLE DI PUNTI iv. MODELLAZIONE 3-D

Prima di procedere all’acquisizione dell’oggetto reale viene eseguita una fase di preparazione della superficie da rilevare. Inoltre per evitare i disturbi legati a difetti della luminosità ambientale ed il problema dei punti sparsi ( Rumore Visivo ) l’acquisizione viene eseguita al buio.

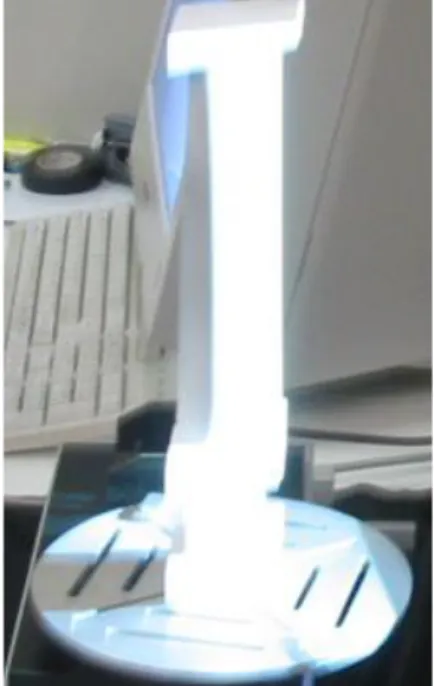

È necessario opacizzare la superficie dell’oggetto fisico da scansionare in funzione delle sue caratteristiche morfologiche, evitando la formazione di zone sovraesposte ( molto riflettenti ) alla luce codificata, altrimenti non rilevabili ( fig. 3.10 ).

Lo strato di opacizzante omogeneo viene realizzato estremamente sottile, dell’ordine del micrometro, per non alterare il profilo rilevato dell’oggetto fisico.Generalmente si utilizzano spray comuni, adoperati per controlli non distruttivi e facilmente rimovibili una volta effettuata la scansione.

3.3.i

Calibrazione del sistema di acquisizione

Il processo di calibrazione permette di determinare i parametri intrinseci ed estrinseci di ogni singola telecamera separatamente, risolvendo una relazione vettoriale del tipo

w

B

c

=

⋅

( 3.6 )dove rappresenta il vettore contenente le coordinate immagine determinate sul piano di retina della telecamera degli n punti appartenenti al provino ( fig. 3.11 ) utilizzato per la procedura di calibrazione della singola telecamera, mentre il vettore contiene le coordinate relative agli stessi n punti del provino determinate rispetto ad un riferimento assoluto.

c

w

La matrice , detta matrice di proiezione, è una matrice di trasformazione tra il sistema di riferimento assoluto ed il riferimento relativo

B

(

X

w,

Y

w,

Z

w)

(

X ,

fY

f)

, solidaleal piano di retina. In essa sono accorpati sia i parametri intrinseci che quelli estrinseci, ancora incogniti.

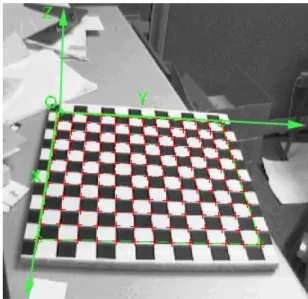

Nella figura 3.11 è raffigurato il provino utilizzato per la calibrazione sia della camera destra che della camera sinistra, sul quale le crocette rosse corrispondenti ai vertici dei quadrati della scacchiera, costituiscono dei punti di riferimento che il software di calibrazione utilizza per determinare la corrispondenza tra gli punti del provino nel riferimento assoluto e gli stessi ottenuti dall’acquisizione nel piano di retina.

n

I vettori

w

e sono noti, difatti il primo è costituito dalle coordinate dei punti sul provino di calibrazione rispetto ad un riferimento assoluto solidale al provino stesso, mentre per il secondo vettore le coordinate sono misurabili elaborando le immagini digitali acquisite del provino di calibrazione.c

In tal modo viene determinata la matrice di proiezione e la corrispondenza tra il sistema di riferimento solidale al piano di retina e quello solidale al provino per la singola telecamera del sistema di acquisizione stereo.

B

In modo equivalente viene ripetuta la stessa procedura di calibrazione per l’altra camera CCD, determinandone i parametri intrinseci ed estrinseci.

Infine viene eseguita una calibrazione conclusiva di entrambe le telecamere, al fine di ottimizzare la valutazione delle caratteristiche estrinseche ed intrinseche del sistema stereo e la posizione spaziale di una camera rispetto all’altra. Partendo da un sistema di riferimento solidale ad una camera, generalmente la camera di destra, si determinano in base ai parametri intrinseci estrapolati dalle calibrazioni delle singole telecamere, le componenti della matrice di rotazione

R

e del vettore traslazioneT

.I parametri ottenuti permettono di effettuare una stima iniziale della posizione relativa tra le due camere CCD, stima che viene successivamente ottimizzata determinando i valori corretti delle due matrici

R

eT

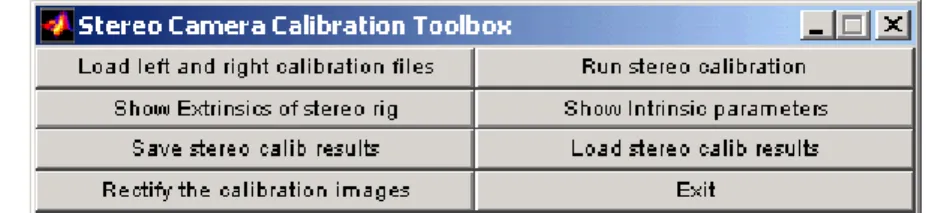

.Le fasi di calibrazione prevedono l’utilizzo di alcune toolbox di Matlab® per l’elaborazione digitale delle immagini acquisite dalla singola camera ( fig. 3.12 ) e per quelle rilevate dal sistema stereovisivo ( fig. 3.13 ).

Figura 3.12 Pannello di controllo per il processo di calibrazione della singola telecamera.

Figura 3.13 Pannello di controllo per il processo di calibrazione della Coppia di telecamere.

Le calibrazioni delle singole telecamere e dell’intero sistema di acquisizione stereoscopico vengono generalmente effettuate un’unica volta, relativamente alla fase di assemblaggio delle camere stesse su supporto fisso.

Ogni qualvolta è previsto l’uso della tavola rotante nel processo di scansione 3-D è necessario effettuare una calibrazione supplementare, che determina una corrispondenza tra la rotazione del provino posizionato sulla tavola stessa e le immagini digitali acquisite per ogni angolo di rotazione della tavola (fig. 3.14 ).

Figura 3.14 Interfaccia grafica della routine di Matlab® per la calibrazione ed il controllo cinematico della tavola rotante e per l’acquisizione dei dati 3-D nelle varie configurazioni spaziali.

Ogni singola calibrazione richiede un elevato numero di corrispondenze ( >> 7 ) tra i punti 3-D appartenenti al provino nel riferimento assoluto e i punti 2-D coniugati solidali al piano di retina.

Per massimizzare quindi l’accuratezza nella rilevazione dei punti immagine il rettangolo di selezione ( fig. 3.15 ) viene preso in modo più ampio possibile, compatibilmente alle dimensioni del provino ed al campo visuale del sistema di acquisizione stereoscopico.

In una prima fase, di set-up per il sistema di stereo visione, viene stabilita la distanza alla quale effettuare la scansione in funzione delle performance dell’ottica, delle telecamere e del proiettore, considerando la precisione richiesta per i dati rilevati e le dimensioni dell’oggetto reale.

Figura 3.15 Rappresentazione del rettangolo di selezione che l’utente è tenuto a tracciare sull’immagine acquisita, per permettere al software di calibrazione l’estrazione dei punti d’interesse.

Tramite il software di gestione del sistema stereo visivo, che permette la visualizzazione delle immagini acquisite su monitor, vengono tarate le posizioni della camera destra e sinistra, in modo tale da ottenere un’immagine il più possibilmente centrata del provino. Successivamente viene eseguita la messa a fuoco delle telecamere e la taratura dell’apertura dei diaframmi, in funzione della luminosità

ambientale, evitando la presenza di zone sovra esposte che causerebbero la perdita di definizione nell’immagine digitale.

Dopo questa prima fase di set-up vengono acquisite le coppie di immagini relative alle due telecamere per ogni posizione della tavola rotante.

L’estrazione dei punti viene fatta tramite una routine del software di acquisizione, che dopo aver definito le dimensioni in pixel del puntatore rettangolare, determina all’interno dell’area tracciata i massimi gradienti dell’intensità di grigio, per individuare con precisione i vertici dei quadrati costituenti la scacchiera.

Effettuata l’estrazione dei punti d’interesse da tutte le immagini digitali del provino, il software prevede il calcolo dei parametri di calibrazione del sistema attraverso un procedimento iterativo basato sul metodo dei Minimi quadrati.

Le toolbox di Matlab® permettono inoltre la visualizzazione dell’errore di riproiezione ( fig. 3.16 ), tramite il quale è possibile individuare le immagini acquisite caratterizzate dagli errori maggiori e scansionarle ulteriormente per ottimizzare la calibrazione del modello.

Figura 3.16 Visualizzazione dell’Errore di Riproiezione. Ogni immagine acquisita è caratterizzata da un colore diverso, ciò permette di avere visivamente una stima dell’errore relativo alle singole immagini. Nel caso di figura si notano un certo numero di punti neri e viola abbastanza lontani rispetto alla nuvola centrale, in questo caso sarebbe opportuno effettuare una riestrazione delle immagini associate.

3.3.ii

Acquisizione e ricostruzione 3-D dei dati rilevati

( Elaborazione digitale delle nuvole dei punti )

Terminata la fase di calibrazione del sistema costituito da due telecamere CCD, attraverso una routine sviluppata in Matlab® si procede all’acquisizione ed alla ricostruzione tridimensionale dei punti rilevati ( nuvole di punti ) in ogni configurazione spaziale assunta dalla paletta ( fig. 3.17 ), solidale alla tavola rotante.

Figura 3.17 Fasi di acquisizione tridimensionale, relative alle successive configurazioni fatte assumere al modello della paletta.

La ricostruzione 3-D, come è stato accennato nel 2° capitolo, è sviluppata con la tecnica di triangolazione ottica attiva, basata sull’algoritmo del “ Ray Intersection” .

Determinata una coppia di punti coniugati e , appartenenti rispettivamente ai piani di retina della camera sinistra e destra, il punto 3-D corrispondente viene ottenuto con una procedura di triangolazione ( fig. 3.18 ) considerando i parametri intrinseci ed estrinseci ottenuti dalla calibrazione del sistema.

l

Q

Q

rFigura 3.18 Schema della ricostruzione tridimensionale.

La correlazione tra le due immagini non richiede nessun intervento da parte dell’operatore, viene risolta automaticamente dal software di acquisizione che lavora sulle proprietà di similitudine tra triangoli per determinare la profondità ( coordinata z ) dei punti 3-D ( fig. 3.19 ).

Le equazioni che vengono risolte dal software di visualizzazione 3-D, nella configurazione particolare con gli assi delle telecamere tra loro paralleli, perpendicolari alla baseline e giacenti sul medesimo piano passante per il punto

P

( fig. 3.19 ), sono :z d x f x l l = + 2 ; z d x f x r r = − 2 . ( 3.7 )

Posta la distanza focale uguale per entrambe le camere CCD, ovvero

f

=

f

l=

f

r si ottiene la seguente relazione :z

y

f

y

f

y

r r l l=

=

. ( 3.8 )Risolvendo le equazioni ( 3.7 ) rispetto al sistema di riferimento assoluto solidale alla paletta, si determina la posizione tridimensionale del punto , ovvero dell’oggetto reale acquisito. Le coordinate 3-D di ogni punto

appartenente alla paletta acquisita e relativamente alla configurazione semplificata

)

(

x

,

y

,

z

P

qui rappresentata, risultano essere :

)

(

)

(

l r r l x x x x d x − + = 2 ;)

(

)

(

l r r l y y y y d y − + = 2 ;(

x

lx

r)

df

z

−

=

( 3.9 )Figura 3.19 Rappresentazione semplificata della tecnica di Ray Intersection utilizzata dalla routine di Matlab® per la valutazione della posizione spaziale dei punti acquisiti. Il processo di rilevazione digitale della paletta ha richiesto l’acquisizione di diverse

patch di superficie, essendo tale oggetto caratterizzato da una geometria spaziale non

standard e molto complessa.

Figura 3.20 Configurazioni del sistema di acquisizione nelle due sessioni di rilevazione. Si può notare come la zona di interesse ( codolo della paletta ) sia interna al campo di visione del digitalizzatore ottico in entrambe le configurazioni.

L’ingombro dell’oggetto da rilevare ha reso necessario svolgere la scansione delle patch superficiali in due sessioni ( fig. 3.20 ).

Per ognuna delle sessioni di rilevazione sono state scansionate otto immagini della paletta, ottenendo le corrispondenti nuvole di punti. Nell’acquisizione complessiva delle sedici patch superficiali dell’oggetto è stato preso come riferimento relativo il codolo del particolare, più precisamente i vertici di questo ( fig. 3.21 ), in modo tale da ottenere dei punti d’interesse utilizzabili nella successiva fase di allineamento dei due gruppi di nuvole.

L’intero processo di rilevazione 3-D ha fornito una nuvola di punti completa di circa 1.040.000 punti.

Figura 3.21 Dettaglio del codolo della paletta e dei punti di riferimento per la registrazione dei due gruppi di nuvole.

3.3.iii

Registrazione delle nuvole di punti

La fase di registrazione delle nuvole di punti è stata effettuata utilizzando il software Geomagic Qualify 7 della Raindrop Geomagic Inc. [13]. Questo software

dedicato gestisce, con estrema flessibilità e facilità, i dati digitali rilevati attraverso il

sistema di stereo visione a luce codificata.

Nel processo di allineamento, il software prevede l’utilizzo di due algoritmi che consentono l’assemblaggio di due o più nuvole di punti. Tali opzioni, la Manual Registration e la Global Registration, richiedono che le nuvole abbiano almeno un punto in comune ( fig. 3.22 ).

Il primo algoritmo, la “ manual registration ”, richiede all’utilizzatore la selezione dei punti di riferimento, comuni alle nuvole da registrare, mentre la “ global registration” è completamente automatizzata e necessita esclusivamente della selezione delle nuvole.

Generalmente, nell’assemblaggio di nuvole relative a patch superficiali con geometria molto complessa, come il caso della paletta, è necessario iniziare il processo di allineamento con la “ manual registration ”, processo che successivamente viene ottimizzato con la “ global registration ”.

Figura 3.22 Registrazione di nuvole di punti (renderizzate) tramite la “manual registration”.

Terminata la fase di allineamento delle nuvole appartenenti allo stesso gruppo, si può procedere con la “ global registration ”, impostando un opportuno valore di tolleranza sulla distanza massima tra due punti omologhi.

La procedura viene poi ripetuta per le nuvole relative alla seconda sessione di acquisizione ed infine si effettua l’assemblaggio dei due gruppi, ottenendo così la nuvola complessiva della paletta utilizzabile per le successive fasi di modellazione 3-D ed eventuale confronto con il modello CAD coniugato ( fig. 3.23 ).

Figura 3.23 Rappresentazione della nuvola di punti finale.

3.3.iv

Modellazione 3-D

Dopo la fase di registrazione delle nuvole di punti, il software Geomagic Qualify 7 consente di svolgere svariate operazioni di modellazione 3-D, al fine di ottenere una geometria puntiforme e successivamente poligonale conforme ai campi di tolleranza stabiliti dall’utilizzatore.

Gli algoritmi utilizzabili consentono alcune operazioni di filtraggio per ridurre il numero complessivo dei punti, eliminare le zone di rumore ottico ( punti acquisiti ma non appartenenti all’oggetto fisico ) e rendere più gestibile il modello stesso. Queste operazioni sono inevitabili soprattutto nelle acquisizioni caratterizzate da molte patch superficiali, relative ad oggetti geometricamente complessi.

In questi casi, l’assemblaggio delle diverse nuvole di punti comporta la formazione di zone di “ overlap “, zone di sovrapposizione di punti omologhi, ovvero punti rappresentati la stessa entità ma appartenenti a nuvole diverse ( fig. 3.24 ).

Tali zone determinerebbero nella successiva fase di triangolazione dei punti delle mesh poligonali irregolari che porterebbero fuori tolleranza il modello finale.

Figura 3.24 Nuvole di punti modificate con algoritmi di filtraggio e modello STL finale. La riduzione dei punti può essere fatta sulla base, ad esempio, della curvatura ( il filtraggio avviene prevalentemente nelle aree a maggiore raggio di curvatura ), oppure campionando uniformemente la nuvola di punti settando dei parametri di riferimento.

Nell’ultimo step del processo di modellazione 3-D la nuvola di punti complessiva viene ricostruita in forma tassellata ( triangolazione della nuvola ), mediante gli strumenti di analisi presenti nel software Geomagic Qualify, ottenendo una rappresentazione STL