Capitolo 2

Test statistici

2.1

Introduzione

Nei capitoli precedenti siamo giunti alla conclusione che, nel caso in cui non sia perfettamente nota la costante dielettrica relativa, la conducibilità elettrica e la posizione relativa dei vari elementi che costituiscono lo scenario nel quale viene effettuata la nostra misura, le variazioni del campo riflesso dalle piastre o dal suolo, osservabili al variare dei parametri precedentemente elencati, possono risultare, su alcuni ricevitori, di notevole entità, mentre il campo diffratto presenta delle variazioni inferiori, tali comunque da non poter essere trascurate.

Per questo si è pensato di considerare la costante dielettrica relativa dell’asfalto come una variabile aleatoria gaussiana con valor medio 15 (tipico dell’asfalto) e deviazione standard pari a 1,5; quella dell’edificio come una v.a. con valor medio 9 (tipico del cemento) e varianza pari a 1. Nel caso in cui la v.a. generata dovesse assumere valori minori o uguali a zero, essa viene posta uguale a 0,01. Una deviazione std. così piccola, impedisce ad εr di raggiungere valori elevati, ma anche valori negativi, il

che comporta un troncamento limitato e quindi, la d.d.p. di εr, potrà essere

considerata a tutti gli effetti gaussiana. Anche la posizione relativa dell’antenna è stata modellizzata come una v.a. gaussiana con valor medio 20 (distanza del trasmettitore dall’edificio misurata in metri) e deviazione std. pari a 0,1 (errore che si pensa di commettere durante la misura). Infine

y = Log σ

e si è modellizzata y come una v.a. gaussiana con valor medio –2,301 e deviazione std pari a 3 per l’asfalto; valor medio –2 e deviazione std. pari a 3,4 per l’edificio.

E’ stata poi valutata, su ciascun ricevitore, la d.d.p. del modulo del campo elettrico, ottenuto per ognuna delle simulazioni realizzate.

Per effettuare questo studio, si è utilizzato lo scenario in Fig. 1.4.13 e 1.4.14 per analizzare il comportamento del campo riflesso dal suolo e dalle piastre dell’edificio; quello in Fig. 1.6.1 e 1.6.2 per il comportamento del campo diffratto; solo che, a causa della pesantezza di calcolo, sono stati inseriti un minor numero di ricevitori (precisamente 16 per lo scenario rappresentato in Fig. 1.4.13 e 1.4.14; 8 per quello rappresentato in Fig. 1.6.1 e 1.6.2).

Infine i parametri elettrici e geometrici del sito sono stati fatti variare uno per volta in diverse simulazioni.

Si è partiti modificando la posizione dell’antenna; lo stesso procedimento è stato poi utilizzato per far variare la costante dielettrica relativa e il logaritmo della conducibilità elettrica sia del suolo che dell’edificio.

Consideriamo per semplicità descrittiva solo il caso della posizione relativa del trasmettitore.

Utilizzando un generatore di variabili aleatorie gaussiane con un certo valor medio (dato dalla posizione iniziale dell’antenna) e una certa deviazione std. (errore che si pensa di commettere nel misurare l’esatta posizione dell’antenna), si è ottenuto un vettore di 1.000 elementi contenente le posizioni nelle quali andremo di volta in volta a sistemare il nostro trasmettitore per effettuare la simulazione. Queste 1.000 posizioni sono state sostituite una per volta all’interno del file del simulatore che contiene le coordinate dell’antenna e, per ogni posizione, EMvironment ha prodotto in uscita, in corrispondenza di ogni punto di osservazione

considerato, un altro vettore sempre di 1.000 elementi contenente i valori del campo calcolati. Sul vettore relativo al singolo ricevitore è stato infine effettuato il test di Kolmogoroff-Smirnoff per stabilire che tipo di processo rappresentasse.

2.2

Descrizione del test di Kolmogoroff-Smirnoff

Il test di Kolmogoroff-Smirnoff viene effettuato sul vettore di 1000 elementi contenente i diversi valori di campo calcolati dal simulatore sul singolo ricevitore per ognuna delle posizioni dell’antenna. Le distribuzioni usate per il confronto sono la Weibull, la K e la gaussiana. Una variabile aleatoria continua x >0 si dice di tipo K se è caratterizzata da una densità di probabilità e da una distribuzione che valgono rispettivamente:

( ) ( )

b x K( ) ( )

b xu x c b x f c K c k K K K k k 1 2 2 − Γ = (2.2.1)( )

( )

b x K( )

b x c x F c K c K K K K K Γ − = 2 2 1 (2.2.2)dove ck >0 è il fattore di forma; bk>0è il fattore di scala; K( ) è la funzione di

Bessel modificata di seconda specie; Γ( ) è la funzione Gamma di Eulero. L’espressione dei momenti ordinari è:

{ }

( )

K K i K i c i i c b x E Γ + Γ + Γ = 2 1 2 2 (2.2.3) Per tale distribuzione, inoltre, i momenti normalizzati di ordine i, definiti come Mi=E{xi}/E{x}i, si possono esprimere nella seguente maniera: Γ + Γ + Γ + Γ = 2 3 2 1 2 1 2 i K i K i c i i c M (2.2.4)

L’altro tipo di distribuzione con il quale si effettua il confronto è quella di Weibull. Una variabile aleatoria continua x >0 si dice di Weibull se ha densità di probabilità e distribuzione dati da:

f

( )

x b c( )

b x w[

( )

b x cw]

u( )

x w c w w w w = − − exp 1 (2.2.5)( )

[

( )

cw]

w w x b x F =1−exp− (2.2.6)Dove bw è il fattore di scala e cw e il fattore di forma.

I momenti ordinari si esprimono nella seguente forma:

{ }

+ Γ = w i w i c i b x E 1 1 (2.2.7) e quelli normalizzati: + Γ + Γ = w i w i c i c i M 1 1 (2.2.8)

Per questo tipo di distribuzione vale la proprietà secondo la quale se una variabile aleatoria è di tipo Weibull, anche quella ottenuta facendo il quadrato della prima è dello stesso tipo; è possibile quindi fare il test di adattamento alla distribuzione di Weibull indifferentemente sul modulo o sul modulo quadro del campo elettrico. La distribuzione di Weibull ha come casi particolari le distribuzioni di Rayleigh ed esponenziale per cw=2

e cw =1.

Una variabile aleatoria continua x >0 si dice di Gauss se ha densità di probabilità e distribuzione dati da:

( )

(

)

− − = 2 2 2 exp 2 2 1 σµ πσ x x fg (2.2.9)( )

(

)

− − − = 2 2 2 exp 2 2 1 1 σ µ πσ x x Fg (2.2.10)dove µ e σ2 sono rispettivamente valor medio e varianza.

Questo tipo di distribuzione per essere caratterizzato ha bisogno solo della conoscenza del valor medio e della deviazione standard (radice quadrata della varianza) che possono essere calcolati usando le formule del valor medio e la varianza campionaria:

{ }

∑

= = = n i i x n x E 1 1 µ (2.2.11)

{

}

(

)

2 1 2 1 ) (∑

= − = − = n i i x n x E µ µ σ (2.2.12)dove n rappresenta il numero di campioni a disposizione sui quali si effettua il test.

Per decidere se la distribuzione del campo ottenuta dal simulatore sia approssimabile mediante la distribuzione di Weibull, la K o la gaussiana occorre svolgere dei test statistici. Per effettuare un test statistico occorre, dato il campione da testare, effettuare su di esso un’ipotesi statistica H0.

Supposto che sia vera l’ipotesi H0, se dal campione casuale si ottengono

risultati che differiscono notevolmente da quelli attesi sulla base delle ipotesi formulate, si dice che le differenze osservate sono significative e l’ipotesi H0 va respinta. Nell’accettare o scartare un’ipotesi si possono

commettere degli errori; nel caso in cui si scarti un’ipotesi vera si dice che si commette un errore di primo tipo, se invece si accetta un’ipotesi falsa si compie un errore di secondo tipo. Le probabilità di commettere tali errori si indicano con:

-τ probabilità di errore di primo tipo; -β probabilità di errore di secondo tipo.

Un test di ipotesi è valido se minimizza la probabilità di errore di primo e secondo tipo, cosa solitamente non semplice in quanto, fissata la dimensione del campione, i tentativi fatti per diminuire gli errori di un tipo sono accompagnati da un aumento degli errori dell’altro tipo.

Dato che di volta in volta, l’errore di un tipo risulta essere più grave dell’errore dell’altro tipo, si cerca di trovare un trade-off preoccupandosi soprattutto dell’errore più importante. Solo aumentando la dimensione del campione si possono ridurre entrambi gli errori, ma questa è una via non sempre praticabile, come ad esempio nel nostro caso, in quanto

aumentando le dimensioni del vettore, aumenterebbe in maniera notevole il tempo necessario per effettuare le simulazioni.

Nell’operare un test di ipotesi, la massima probabilità con la quale si è disposti ad accettare un errore di primo tipo è detta livello di significatività

del test e si indica con α. Se la probabilità di errore di primo tipo calcolata τ è minore di α si può respingere l’ipotesi H0. Il livello di significatività si

specifica prima di aver ottenuto il campione in modo che i risultati non influenzino la scelta. I livelli di significatività più usati sono α =0.05 e

α=0.01. Nei test effettuati si è utilizzato α =0.05.

E’ ora importante introdurre il concetto di intervallo di fiducia. Per ogni test è possibile definire una statistica il cui valore consente di determinare la fondatezza o meno dell’ipotesi H0 di partenza. Si definisce allora intervallo di fiducia quel particolare intervallo, i cui estremi sono funzioni del livello

di fiducia α, nel quale deve rimanere il valore della statistica del test affinché non venga respinta l’ipotesi H0. Se questa è vera si ha:

Pr{a (α) < h < b(α)} =1-α (2.2.13)

dove h rappresenta la statistica del generico test. Si considerino due ipotesi: l’ipotesi H0 che il campione abbia una funzione di distribuzione

teorica Fo(x) e l’ipotesi alternativa H1 che il campione si discosti da tale

distribuzione.

I test statistici nei quali l’ipotesi H0 viene testata contro l’ipotesi H1 sono

dei test di adattamento perché misurano quanto la distribuzione empirica del campione di n elementi Fn(x) si adatta alla distribuzione teorica. I test

di adattamento più usati sono quelli del χ2 e quello di

Kolmogoroff-Smirnoff, tra questi si è usato il secondo. Uno dei motivi di tale scelta è dovuto al fatto che il test del χ2 è migliore per rilevare le irregolarità in

sensibile nel rilevare scostamenti della funzione di distribuzione da un dato andamento.

Viene ora fornita una descrizione di come viene condotto il test. L’ipotesi nulla H0 e quella alternativa H1 sono quelle già definite per i test di

adattamento. La statistica del test è calcolata in base alla massima differenza tra la distribuzione empirica del campione a n elementi in esame Fn(x) e quella teorica nota F0(x). Se si indica con D la statistica si

ha: D= n

.

Fn( )

x Fo( )

x x≤∞ − ≤ ∞ −max (2.2.14)in cui il fattore n è giustificato dal fatto che, per x fissato, la deviazione

standard di Fn(x) da F0(x) è proporzionale a 1/ n , moltiplicando quindi

per n si rende la statistica del test quasi indipendente dalla dimensione del campione. Per la statistica D del test di Kolmogoroff-Smirnoff la (2.2.13) diventa:

Pr{0<D<b(α)} =1-α (2.2.15)

dove:

- a(α) = 0 per come è stato definito D

b(α) α 1,073 0,2 1,138 0,15 1,224 0,1 1,358 0,05 1,628 0,01 1,949 0,001 TABELLA 2.2.1

Per il valore del livello di significatività scelto α =0.05 si ha b(α) =1,358. Eseguire il test significa quindi calcolare D e se D> b(0.05) l’ipotesi H0

viene respinta. Si può anche stimare la probabilità di errore di primo tipo τ per il valore di D già calcolato. Utilizzando la funzione di distribuzione per D:

( )

( )

(

2 2)

1 1 exp 1 2 1 j D D Q j j KS = − − − − ∞ =∑

(2.2.16) si ha che: τ =1−QKS( )

D (2.2.17)che confrontata con α consente di stabilire se l’ipotesi vada respinta, nel caso in cui si abbia α>τ.

Il test di Kolmogoroff-Smirnoff, come del resto tutti i test di ipotesi, è un test che consente di scartare l’ipotesi nulla H0, se la statistica del test è

superiore a b(α), con probabilità di errore del primo tipo inferiore ad α, se però si è nella condizione di non poter respingere l’ipotesi H0 esiste una

compiere alcuna scelta. Comunque se τ è abbastanza superiore al livello di significatività, β è sicuramente bassa (infatti al crescere di τ cresce β) e quindi si può assumere come vera l’ipotesi H0, secondo la quale il

campione è ripartito con la distribuzione teorica F0(x) che è oggetto del

test. In tabella 2.2.2 si schematizza il test appena descritto.

Nell’effettuare il test di Kolmogoroff-Smirnoff in realtà anziché la (2.2.14) vengono calcolate le due differenze massime positiva e negativa come suggerito da Smirnoff modificando il test originario di Kolmogoroff:

( )

[

]

( )

( )

[

F x F x]

n D x F x F n D n x n x − = − = ∞ ≤ ≤ ∞ − − ∞ ≤ ≤ ∞ − + 0 0max

max

( )Il vantaggio è che la distribuzione limite per D+ e D-, se n >1.000, è

F∞

( )

τ =1−exp( )

−2t2 . (2.2.18)Tabella riassuntiva dei test di significatività

Consideriamo le ipotesi H0 e H1:

H0: il campione ha una funzione di distribuzione pari a quella teorica F(x). H1: il campione si discosta da F(x).

sia

Pr{H1|H0} =τ probabilità di errore di I tipo

si sceglie α livello di fiducia (o livello di significativita`); si ricava allora l’intervallo di fiducia che è tale che

Pr{a(α)‹ h ‹ b(α)} =1-α

Dove h è la statistica del test pari a maxFn(x)-F(x).

Se τ<α ⇒ H1

Se τ>α è necessario valutare h

• se h ∉[a(α),b(α)] ⇒H1 commettendo un errore del I tipo con

probabilità τ>α.

• se h ∈[a(α),b(α)] ⇒H0 commettendo un errore del II tipo β

con probabilità tanto più bassa quanto più τ>α.

Tabella 2.2.2

E’ quindi possibile effettuare un test di questo tipo: si fanno N test su campioni abbastanza ridotti, ad esempio n =1.000, dai quali si ricavano 2 campioni di N elementi contenenti rispettivamente i valori assunti dalle statistiche D+ e D-, quindi si esegue un altro test confrontando le

distribuzioni empiriche di D+ e D- con la (2.2.18).

Prima di effettuare il test occorre però ordinare il campione in ordine crescente in modo da rendere più agevole la determinazione di Fn(x);

infatti per un campione ordinato si ha:

( )

. n i xPer effettuare il confronto utilizzando il test di Kolmogoroff-Smirnoff occorre conoscere la distribuzione teorica con la quale effettuare il confronto. Infatti come si può osservare dalle (2.2.2), (2.2.6), (2.2.9), sia la distribuzione K che quella di Weibull hanno due parametri , il fattore di

scala ed il fattore di forma, che occorre determinare prima di effettuare il

test, mentre per la gaussiana basta calcolare valor medio e varianza. Per determinare il valor medio e la varianza del vettore dei dati basta usare la formula del valor medio e la varianza campionaria ossia:[Rif. 4]

{ }

∑

= = = n i i x n x E 1 1 µ (2.2.20){

}

(

)

2 1 2 1 ) (∑

= − = − = n i i x n x E µ µ σ (2.2.21)Invece per determinare il fattore di scala e di forma, si suppone che il campione sia effettivamente ripartito con il tipo di distribuzione della quale si vogliono calcolare fattori di scala e di forma. Da tale campione è quindi possibile determinare i momenti non normalizzati definiti nel modo seguente: n a m n j i j i

∑

= = 1 dove:-aj indica il generico elemento del campione; -n indica il numero degli elementi

Imponendo l’uguaglianza tra i primi due momenti del campione e quelli dati rispettivamente dalla (2.2.3) o dalla (2.2.7), a seconda che si voglia determinare il fattore di forma della K o della Weibull, si ottengono così due sistemi di equazioni in due incognite, uno per la K e uno per la

Weibull. Risolvendo tali sistemi si ottengono i parametri delle distribuzioni teoriche con cui confrontare il campione.

Riassumendo, per poter svolgere il test di Kolmogoroff-Smirnoff le operazioni da svolgere sono, nell’ordine:

1 - Calcolare il modulo del campo elettrico su cui effettueremo il test. 2 - Ricavare i fattori di scala e di forma per la distribuzione K e per la Weibull, e il valor medio e la varianza per la gaussiana.

3 - Disporre i dati in un vettore ordinato in ordine crescente. 4 - Eseguire il test di Kolmogoroff-Smirnoff usando:

- il vettore di dati di cui si vuol conoscere la distribuzione:

- il tipo di distribuzione con il quale si vuole effettuare il confronto; - il fattore di scala e quello di forma, oppure il valor medio e la varianza, a seconda del tipo di distribuzione con il quale si effettua il confronto.

Dalle operazioni di cui al punto 4, si ottiene il valore della statistica D del test e la probabilità di errore di primo tipo τ.

2.3

Esempi di simulazioni e risultati dei test statistici

In questo paragrafo vengono mostrati alcuni esempi di simulazione effettuati con il codice di simulazione sviluppato.

Il primo scenario preso in considerazione è quello in Fig. 1.4.13 e 1.4.14, in cui, come già detto, sono stati posizionati solo 16 ricevitori per semplicità di calcolo. Su ciascuno dei ricevitori posti lungo la strada, è stato effettuato

determinare il tipo di distribuzione del campo Elettrico (dovuto ai raggi diretti, riflessi dal suolo e dalle piastre) al variare: della posizione dell’antenna, della costante dielettrica relativa dell’asfalto o dell’edificio, ed infine della conducibilità elettrica sempre dell’asfalto o dell’edificio. Lo stesso test è stato poi effettuato sullo scenario in Fig 1.6.1 e 1.6.2 con le medesime modalità, per determinare il tipo di distribuzione del campo elettrico dovuto, in questo caso, ai raggi diretti, riflessi dal suolo e diffratti dagli spigoli.

Qui di seguito vengono rappresentati i risultati ottenuti nel caso in cui si varia la posizione dell’antenna, considerando l’ascissa x di tale posizione come una variabile aleatoria gaussiana come descritto in precedenza, e relativi ai primi 8 ricevitori, dato che, per simmetria, essa è la stessa sui restanti 8.

I ricevitori sono stati numerati a seconda del sito, come mostrato in Fig. 2.3.1 ((a) per il sito in Fig 1.4.13 e 1.4.14, (b) per quello in Fig. 1.6.1 e 1.6.2):

b)

Figura 2.3.1

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.22248

Distribuz K 0 17.36947

Distribuz. Gaussiana 0.6192 0.754719

Tabella 2.3.1: Test statistici relativi al ricevitore n. 1 al variare della posizione dell’antenna

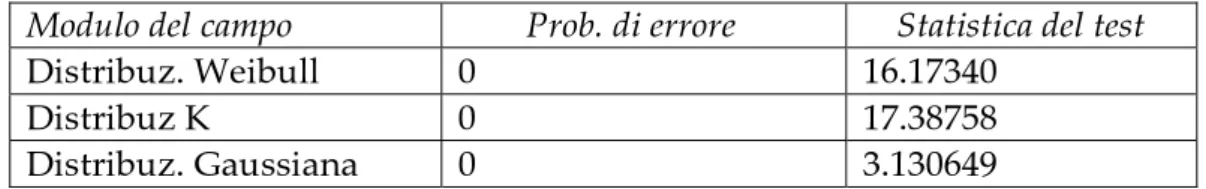

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.17340

Distribuz K 0 17.38758

Distribuz. Gaussiana 0 3.130649

Tabella 2.3.2: Test statistici relativi al ricevitore n. 2 al variare della posizione dell’antenna

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.38060

Distribuz K 0 17.34271

Distribuz. Gaussiana 0.4974958 0.8291678

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.15924

Distribuz K 0 17.17395

Distribuz. Gaussiana 0.7165751 0.6967882

Tabella 2.3.4: Test statistici relativi al ricevitore n. 4 al variare della posizione dell’antenna

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 15.84301

Distribuz K 0 17.14736

Distribuz. Gaussiana 0.8734317 0.5929859

Tabella 2.3.5: Test statistici relativi al ricevitore n. 5 al variare della posizione dell’antenna

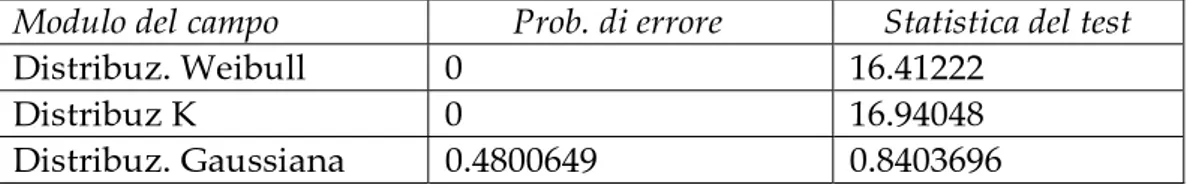

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.41222

Distribuz K 0 16.94048

Distribuz. Gaussiana 0.4800649 0.8403696

Tabella 2.3.6: Test statistici relativi al ricevitore n. 6 al variare della posizione dell’antenna

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.72845

Distribuz K 0 17.28155

Distribuz. Gaussiana 0.1117437 1.200941

Tabella 2.3.7: Test statistici relativi al ricevitore n. 7 al variare della posizione dell’antenna

Modulo del campo Prob. di errore τ Statistica del test

Distribuz. Weibull 0 16.91818

Distribuz K 0 15.82472

Distribuz. Gaussiana 7.6174736E-05 2.255591

Tabella 2.3.8: Test statistici relativi al ricevitore n. 8 al variare della posizione dell’antenna

Dai risultati ottenuti si può affermare che, variando la posizione dell’antenna, la densità di probabilità del modulo del campo elettrico sui ricevitori numero 1, 3, 4, 5, 6 7 e per simmetria anche su quelli numero 10, 11, 12, 13, 14, e 16, è ancora gaussiana; mentre sui ricevitori 2 e 8 e per simmetria 9 e 15, tale densità di probabilità non è identificabile con nessuna di quelle utilizzate nel confronto. Questa diversità di comportamento è dovuta al fatto che, sul ricevitore numero 2 (opp 8), l’angolo con il quale il raggio diretto incide al suolo, prima di riflettersi nel punto di osservazione considerato, è pari a 72°. Tale angolo (come si può notare dalla Fig. 1.3.1) è vicino a quello di Brewster, e di conseguenza il modulo del coefficiente di riflessione è molto piccolo. Quindi il campo totale risulterà essere quasi deterministico. Bisogna considerare inoltre che la distanza tra trasmettitore e punto di osservazione (che abbiamo supposto aleatoria), è presente anche all’interno del termine di fase del campo elettrico, perciò i vari raggi su un ricevitore si sommeranno con una certa fase non più deterministica, e non è detto che il modulo del campo resti ancora una variabile aleatoria gaussiana. Questo accadrebbe invece se tale distanza intervenisse unicamente nel modulo del campo come termine di attenuazione. In aggiunta c’è da considerare che, sui due ricevitori centrali (8 e 9) cambia anche lo scenario, infatti solo su di essi termina, oltre al raggio diretto e riflesso dal suolo, anche quello riflesso dalle piastre dell’edificio che ovviamente dipende dalla posizione dell’antenna.

Variando invece la conducibilità elettrica o la costante dielettrica relativa dell’asfalto, il test statistico effettuato non dà risultati. Si può quindi concludere dicendo che, in questo caso, la densità di probabilità del modulo del campo elettrico su ogni ricevitore, non appartiene a nessuna delle famiglie di densità di probabilità utilizzate per il confronto nel test di

Variando infine la conducibilità elettrica o la costante dielettrica relativa dell’edificio, il valore del modulo del campo elettrico sui ricevitori numero 1, 2, 3, 4, 5, 6, 7 e per simmetria anche su quelli numero 10, 11, 12, 13, 14, 15 e 16, è deterministico dato che, su di essi non termina alcun raggio riflesso dalle piastre dell’edificio. Invece sul ricevitore numero 8 e per simmetria su quello numero 9 il test di confronto, ancora una volta, non dà risultati. Quindi, anche in questo caso, la densità di probabilità del modulo del campo elettrico su tali ricevitori, non è identificabile con nessuna delle densità di probabilità utilizzate per il confronto nel test di Kolmogoroff-Smirnoff.

Se ora si prende in considerazione lo scenario rappresentato in Fig. 1.6.1 e 1.6.2 , utilizzato per l’analisi del campo diffratto, e si fa variare, alla stessa maniera delle precedenti simulazioni, la posizione relativa dell’antenna, la costante dielettrica relativa e la conducibilità elettrica dell’edificio, si osserva che, in nessun caso, il test statistico effettuato, fornisce dei risultati. Possiamo quindi concludere che, ancora una volta, la d.d.p. del modulo del campo elettrico su ogni ricevitore, non è identificabile con nessuna delle famiglie di d.d.p. utilizzate per il confronto all’interno del test.